情報通信系 News

映像がぴったり貼りつく 動く顔へのプロジェクションマッピング

高速かつ高精度な投影でエンターテイメントや化粧のシミュレーションに活用

ポイント

- 顔に投影するダイナミックプロジェクションマッピングの映像ずれを大幅に低減

- 顔のパーツを検出する処理の並列化と、レンズシフト機能を搭載した同軸光学系の採用で高速化と高精度化を実現

- 顔の外観を一瞬で塗り替える体験を、エンターテイメントや化粧のシミュレーションなどの幅広い応用に提供

概要

東京科学大学(Science Tokyo)※ 工学院 情報通信系の彭浩倫大学院生と渡辺義浩准教授(情報通信コース 主担当)らの研究チームは、動く顔に投影するダイナミックフェイシャルプロジェクションマッピング[用語1]における映像ずれを大幅に低減する技術を提案しました。

これまでのダイナミックフェイシャルプロジェクションマッピングでは、実際の顔のパーツの位置と投影した映像の間に知覚可能なずれが生じるという問題がありました。これは、顔の目・鼻・口などのパーツを検出する処理の遅延や、カメラとプロジェクタの画像座標対応の精度不足によるものです。

そこで本研究では、顔のパーツを検出する処理において、低速・高精度な処理と高速・低精度な処理を並列に実行し、時間的なずれを補正しながら両者の結果を統合することで、わずか0.107msの高速処理と高い処理精度を同時に達成する手法を提案しました。また、既存の静止画の顔画像データセットを用いて、高フレームレート下の顔の動き情報を学習することで、顔の動画像データセットに依存しない機械学習を実現しました。さらに、カメラ光学系にレンズシフト機構を組み込むことで、上向きに投影されるプロジェクタ光学系に整合させて、座標対応の精度を大幅に向上させる同軸光学系[用語2]を提案しました。今回開発した技術は、ダイナミックフェイシャルプロジェクションマッピングの体験を大幅に上げるものであり、エンターテイメントや化粧のシミュレーションなどの応用で役立つと期待されます。

本成果は、1月17日付の論文誌「IEEE Transactions on Visualization and Computer Graphics」に掲載されました。

※ 2024年10月1日に東京医科歯科大学と東京工業大学が統合し、東京科学大学(Science Tokyo)となりました。

背景

ダイナミックフェイシャルプロジェクションマッピングは、顔への映像投影によってその外観を塗り替える技術です。本来は簡単に変わるはずのない顔の外観が一瞬で変化する体験はインパクトが大きく、エンターテイメントの演出や化粧のシミュレーションなどさまざまな分野への応用が始まっています。

このような映像投影による新しい顔が自然に見えるためには、実際の顔と投影される映像がずれないことが重要です。しかし従来技術は、二つの問題により、この要請を満たすことが困難でした。一つ目の問題は、高速かつ複雑に動く顔の目・鼻・口などに遅れなく映像を投影することが難しいことです。これまでの研究により、人間はわずか約4msの映像遅れでも知覚できることが示されています。そのため、この短い時間で、画像の撮像から顔の追跡[用語3]、顔形状の推定、投影像の生成、投影の処理までを完了する必要があります。特に顔の追跡は、高速性と高精度を両立する必要がありますが、これまでの処理手法には、ダイナミックフェイシャルプロジェクションマッピングが求める性能を満たすものがありませんでした。

二つ目の問題としては、カメラで認識された場所にプロジェクタで正確に映像を照射することが難しいという、光学系の構成上の問題があります。動的な対象へのプロジェクションマッピングでは、鏡を介してカメラとプロジェクタを配置する、同軸光学系の構成が広く用いられています。この構成は、カメラから奥行きを取得せずに、カメラ画像内の位置座標とプロジェクタ画像内の位置座標の対応を取ることができる点で優れています。しかしプロジェクタの投影光学系では上向き方向に映像を投影する構成が一般的であるのに対して、カメラの撮像光学系は方向を傾けない構成になっています。このようにプロジェクタとカメラの間で光学系の特性が異なっている状況で、正確な同軸光学系を構築することは難しく、顔と映像の間でずれを生じる要因となっていました。

研究成果

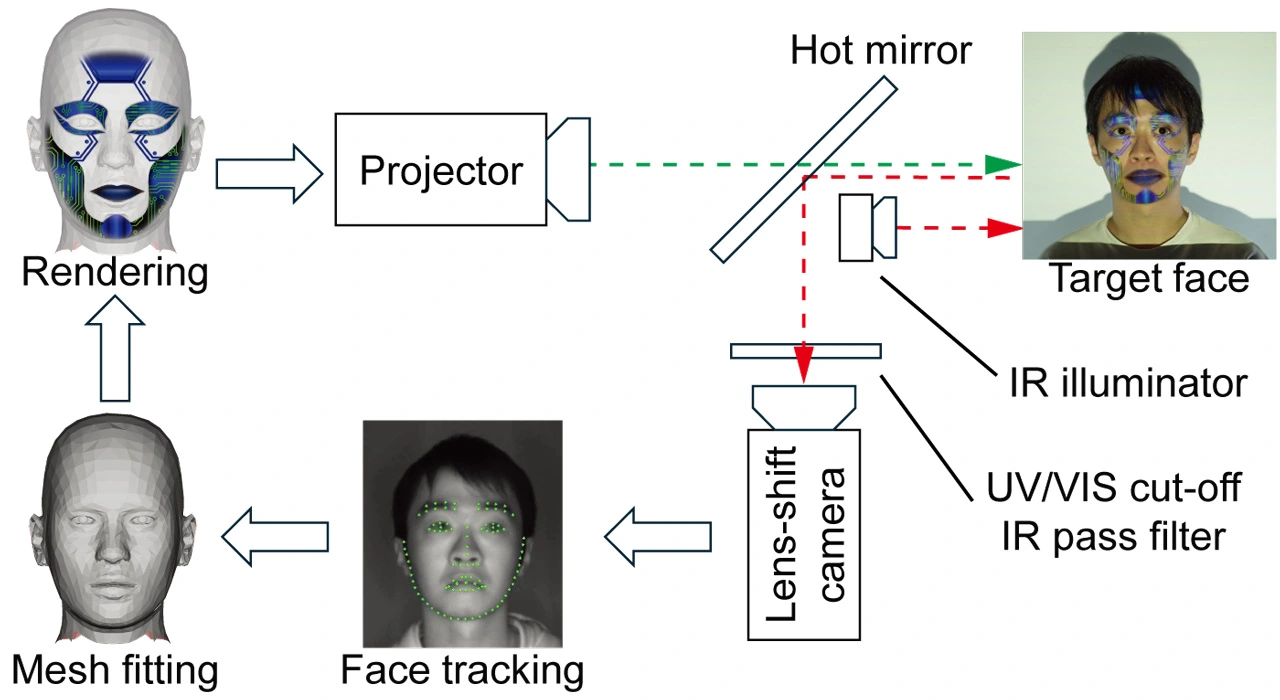

今回提案するシステム(図1)では、一つ目の問題である時間的遅れによる映像ずれを解決するために、高速かつ高精度な顔の追跡を実現する動画像の処理手法を採用しました。前提として、ダイナミックフェイシャルプロジェクションマッピングでは、遅延を最小化するために、500 fpsレベルの高いフレームレート[用語4]で撮像しています。このような高いフレームレート下の動画像では、フレーム間の顔の動きが十分に小さいと仮定できます。この仮定のもと、時系列の動画像のリアルタイム処理では、1フレーム前の結果から、現フレームの顔の目・鼻・口などの特徴点の探索を開始することで、処理時間を大幅に短縮できます。ただし、このような時系列情報のみに頼る処理では、顔の一部が遮蔽されるなどの理由で特徴点検出に一度でも失敗すると、時系列情報を利用する仕組み上、復帰が困難になり、精度が低下する恐れがあります。そこで、時間を要するものの顔特徴点の検出ミスが起こりにくい処理を並列に実行し、その結果の時間ずれを瞬時に補正したうえで、上述の時系列ベースの高速処理に統合することで、検出性能を強化するという手法を新たに設計しました。

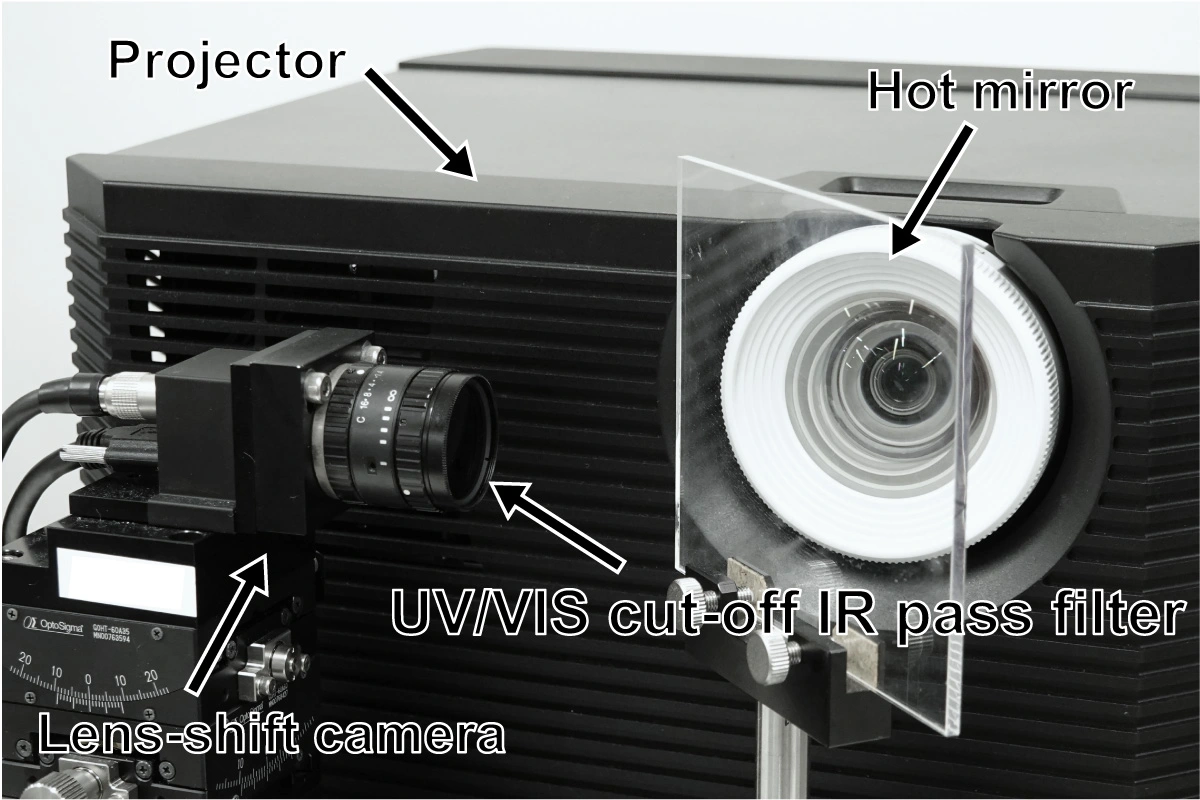

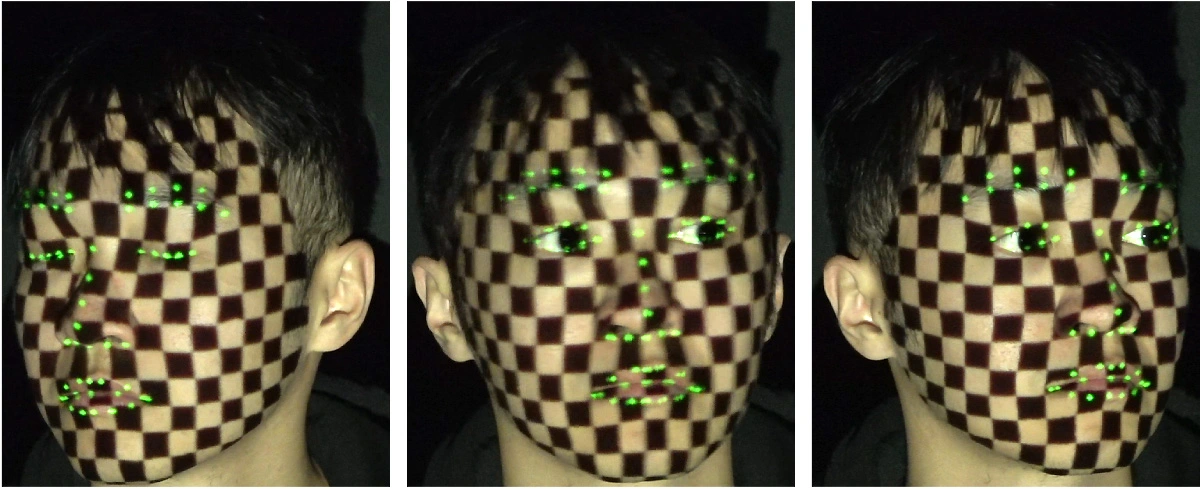

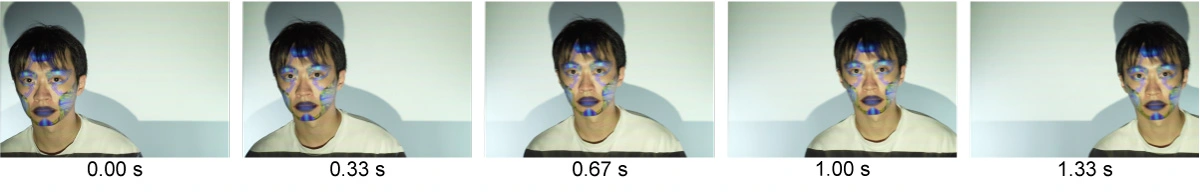

- 図1. 提案システムは、ミラー(Hot mirror)を介して、カメラ(Lens-shift camera)とプロジェクタ(Projector)を配置する同軸光学系の構成となっている。また、プロジェクタの可視光の影響を受けずに顔の認識をするために、赤外域のカメラ画像を用いる。このために、カメラに可視光カットフィルタ(UV/VIS cut-off IR pass filter)を搭載するとともに、赤外照明(IR illuminator)を設置している。本システムのもと、カメラによる撮像、顔の追跡(Face tracking)、顔形状の推定(Mesh fitting)、投影像の生成(Rendering)、投影の順で処理が行われる。顔の追跡の画像内の緑の点は、検出された顔のパーツの位置を示す。

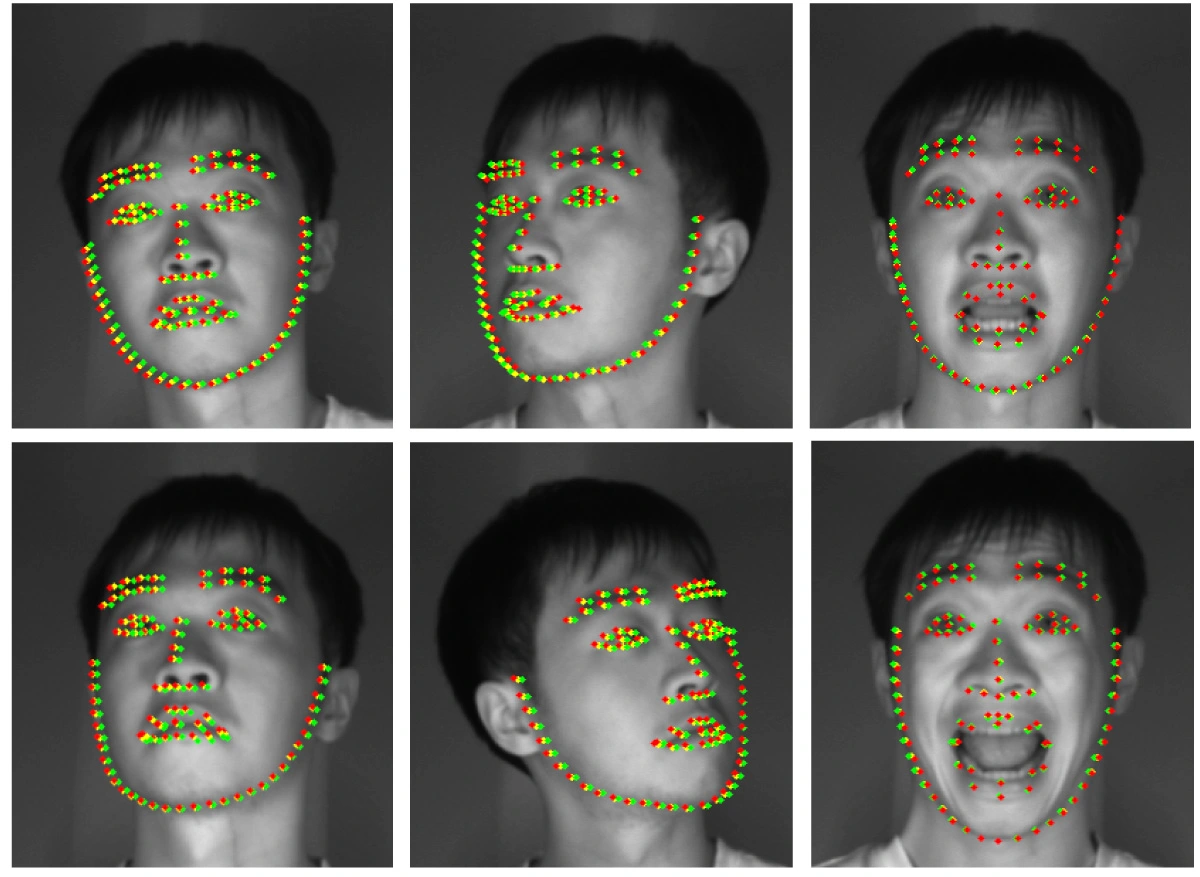

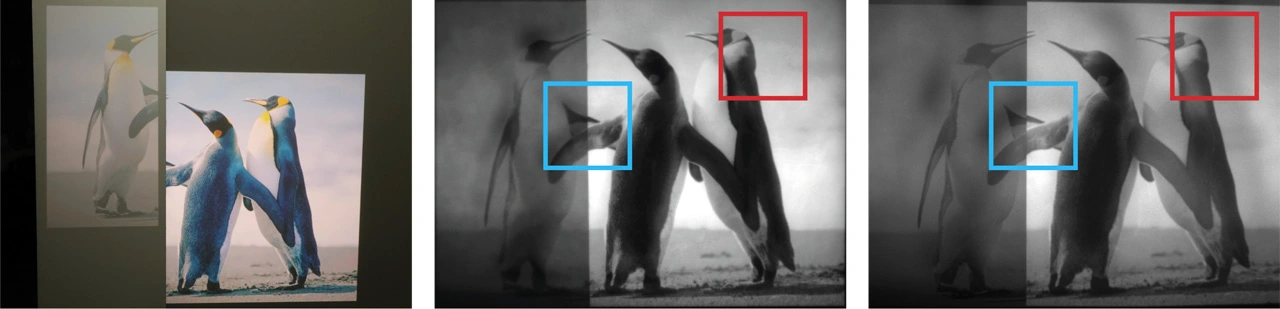

- 図2. 500 fpsの動画像に対する顔の追跡結果。緑の点:提案手法の各画像に対する結果、黄の点:3フレーム前の結果、赤の点:6フレーム前の結果。緑の点が顔の動きに正確に追従していることが分かる。

一方で本システムでは、撮像した動画像の処理に機械学習が必要ですが、高いフレームレートの顔動画像のデータセットが存在しないため、学習を行えないという課題があります。そこで本システムでは、利用可能な静止画の顔画像のデータセットから、高いフレームレートの動画像情報を近似的に機械学習するようにしました。

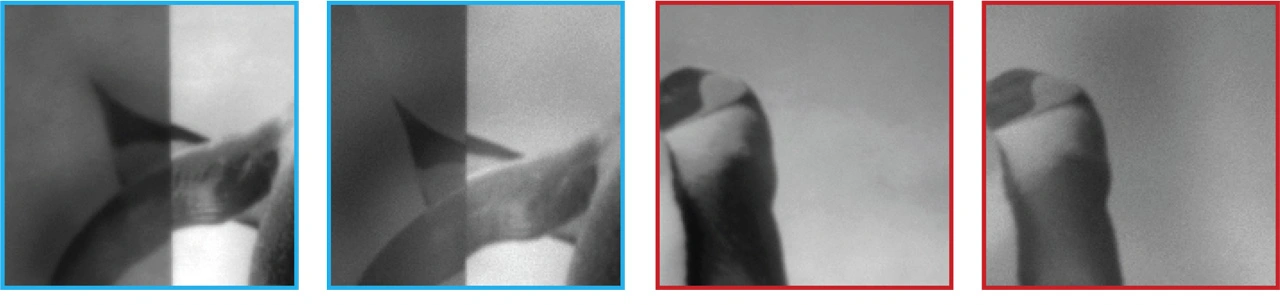

こうした時系列ベースの高速処理と低速・高精度の処理をハイブリッドに統合する手法と、静止画データセットを用いた時系列情報の機械学習を用いることで、顔の追跡をわずか0.107 msの遅延で完了できただけでなく、最新の関連技術と同等の精度も達成しました(図2)。

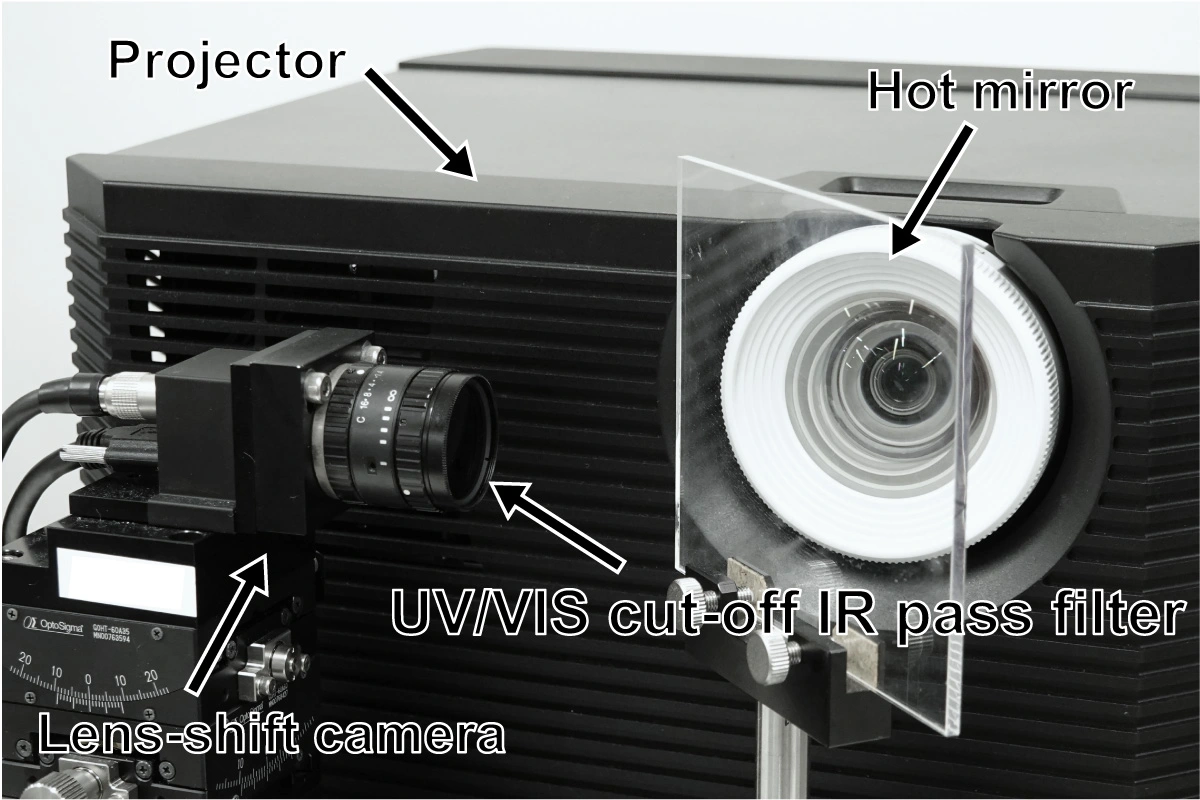

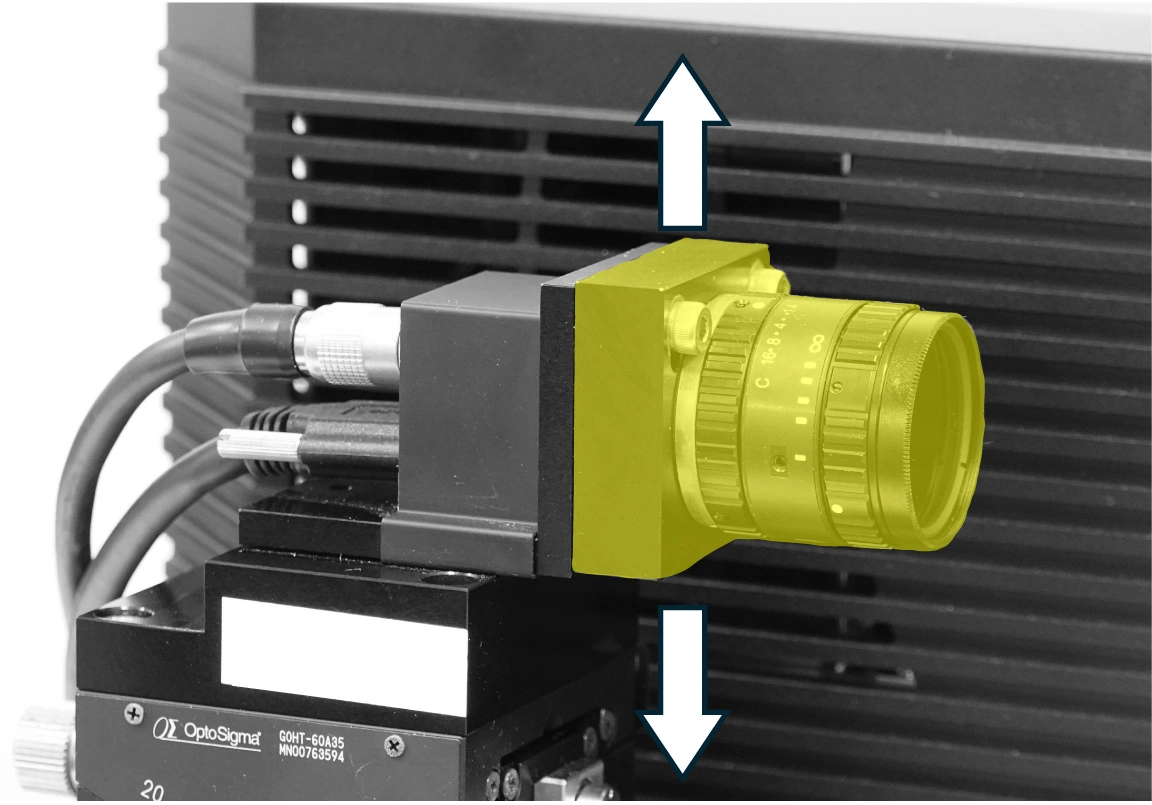

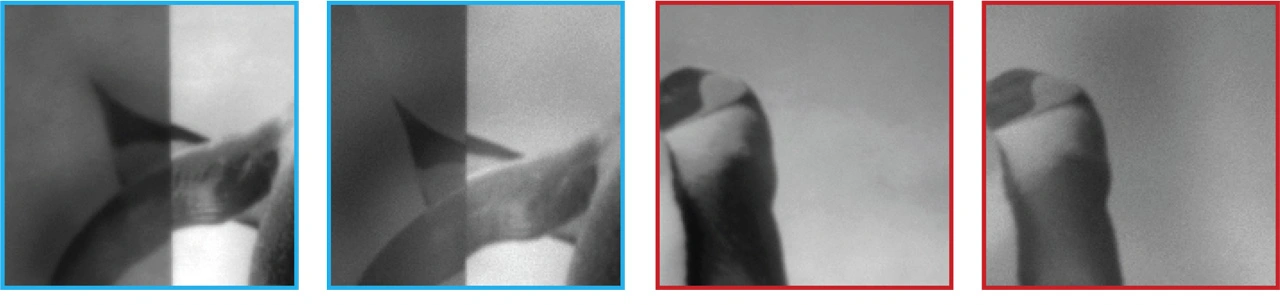

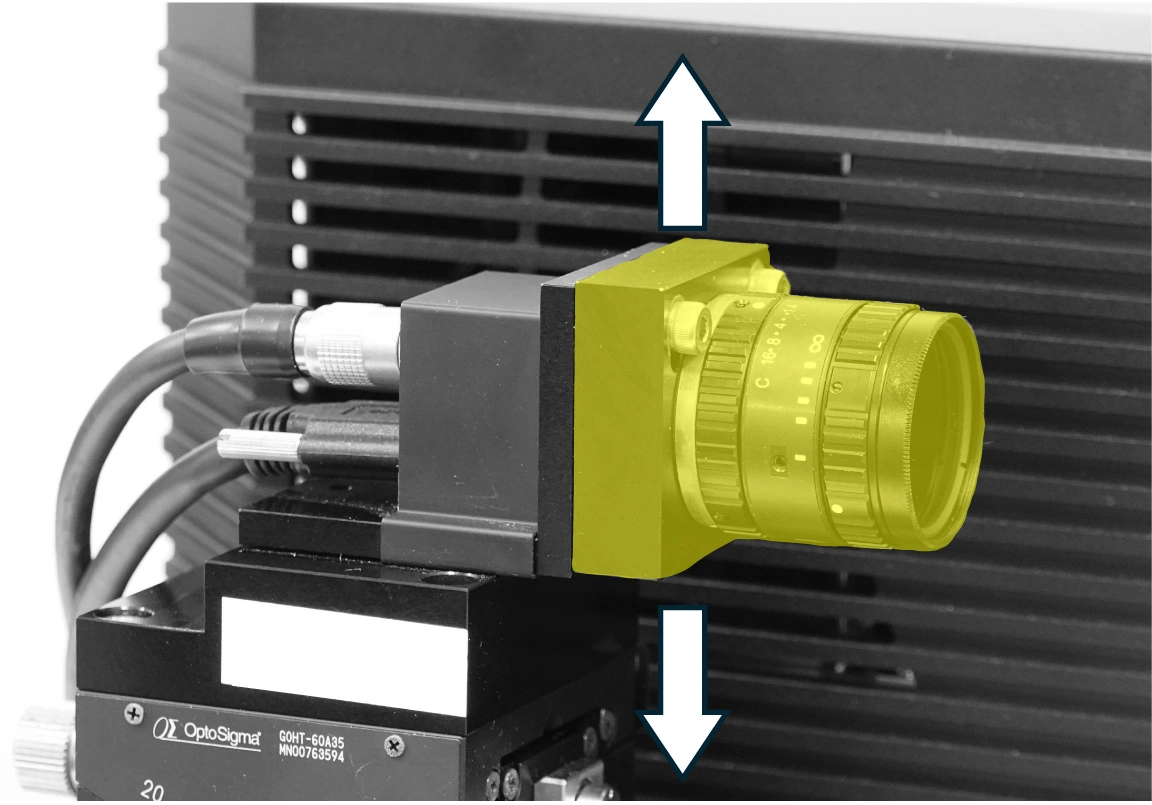

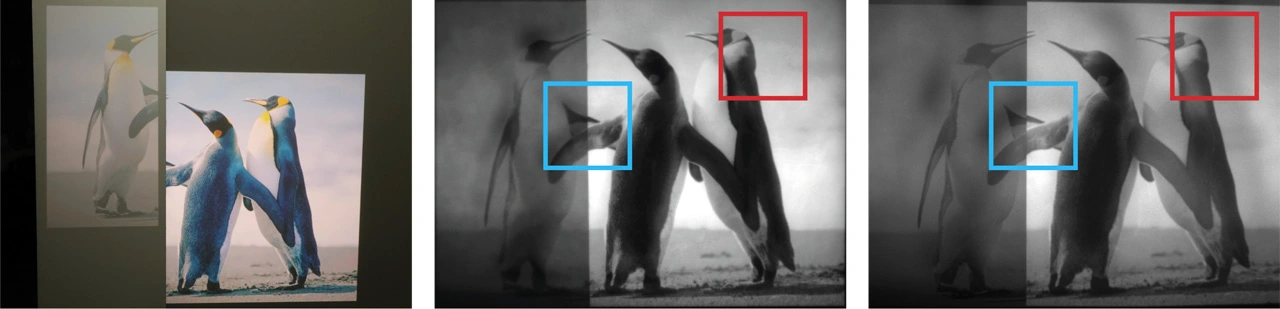

次に、二つ目の問題である、プロジェクタ・カメラの空間的な座標対応のずれを解決するために、新たな同軸光学系を提案しました。従来のシステム構成では、プロジェクタの光学系に合わせてカメラ自体を上向きに配置することで、同軸化を試みていました。しかしそうした構成では正確な同軸化が難しく、ずれの解消が困難です。そこで解決策として、カメラのイメージセンサとレンズを上下方向にずらして配置する、レンズシフトの機構を新たに導入することで、プロジェクタとカメラの光線が同じ条件で同軸化される構成を提案しました(図3)。その結果、座標対応の精度が従来の同軸構成と比べて約10倍向上しました。

- 図3.レンズシフト機構を搭載したプロジェクタ・カメラ同軸光学系。(上段)システム構成。(中段左)システムから1mと2mの距離に置かれた2枚のスクリーンに投影している様子。(中段中央)提案するレンズシフト同軸光学系で投影結果を撮像した様子。(中段右)レンズシフト機構を搭載しない従来の同軸光学系で投影結果を撮像した様子。(下段)中段に示す結果の拡大図。青枠と赤枠の結果はそれぞれ左が提案構成、右が従来構成。提案構成では、異なる距離のスクリーンに投影してもカメラ上ではずれや影がなく、同軸化の精度が高いことが確認できる。

上段_1

上段_2

上段_3

中段

下段

- 図3.レンズシフト機構を搭載したプロジェクタ・カメラ同軸光学系。(上段)システム構成。(中段左)システムから1mと2mの距離に置かれた2枚のスクリーンに投影している様子。(中段中央)提案するレンズシフト同軸光学系で投影結果を撮像した様子。(中段右)レンズシフト機構を搭載しない従来の同軸光学系で投影結果を撮像した様子。(下段)中段に示す結果の拡大図。青枠と赤枠の結果はそれぞれ左が提案構成、右が従来構成。提案構成では、異なる距離のスクリーンに投影してもカメラ上ではずれや影がなく、同軸化の精度が高いことが確認できる。

- 図4.(上段)検出された顔特徴点を緑点で投影するとともに、チェッカーパターンを顔全体にマッピングしている様子。(中段)左右に高速に動く顔へマッピングする様子。各写真下部の数値は経過時間を示す。(下段)ダイナミックな表情変化や一部遮蔽にも高精度に投影が実現されている様子。

最後に、以上の手法を組み込んだ新システムによるダイナミックフェイシャルプロジェクションマッピングを実証しました(図4)。結果として、高速かつ複雑に動く顔に対して、従来技術よりも遅れが小さく、さらに高精度なプロジェクションマッピングを実現できることを確認できました。

社会的インパクト

ダイナミックフェイシャルプロジェクションマッピングは、新しい顔を一瞬で纏うことができる技術です。これまでの顔の常識を塗り替える点で、エンターテイメントにおける演出効果、化粧のMR(Mixed Reality)を活用したシミュレーション(株式会社コーセーと共同研究にて実施)、コミュニケーションの変革など、インパクトの大きい幅広い応用が見込まれています。本論文が提案する技術は、これらの応用をより現実のものとして実利用化するための基盤として役立つことが期待されます。

今後の展開

投影による顔の外観が現実と区別がつかないレベルに到達するためには、映像生成を始めとして、さらなる基盤技術の強化が必要です。また、応用展開においては、特に化粧品分野でのニーズが高く、数多くの化粧を短時間でシミュレーションする社会利用などさまざまな可能性が出てきています。今後は、基盤技術と応用の両輪を回しながら、技術を進化させ、社会普及へとつなげることを目指します。

- 付記

本研究は、下記機関の協力により実施されました。

株式会社コーセー:課題背景に関する議論と投影テクスチャの提供

- 用語説明

| [用語1] | ダイナミックフェイシャルプロジェクションマッピング:動く顔の立体形状や表情変化に合わせて、プロジェクタで映像投影することで、その外観を仮想的に変える技術。エンターテイメントや化粧などで活用されている。 |

|---|---|

| [用語2] | 同軸光学系:ミラー(本研究ではホットミラー(赤外光を反射、可視光を透過する鏡)を利用)を介してプロジェクタとカメラを配置する構成。カメラはミラーで反射された像を捉え、プロジェクタの光はミラーを透過して投影される。ミラーを介することで、カメラとプロジェクタが疑似的に同じ場所に配置された状況を作り出す。これにより、対象までの奥行きを使わずに、カメラの画像上の位置とプロジェクタの画像上の位置の対応関係を得る。 |

| [用語3] | 顔の追跡:画像から顔の目・鼻・口などの特徴的なパーツの位置を検出する処理。 |

| [用語4] | フレームレート:1秒間に画像を撮像・投影する頻度。例えば、1秒間に30回撮像する場合は30 fps(fps: frames per second)。 |

- 論文情報

| 掲載誌: | IEEE Transactions on Visualization and Computer Graphics |

|---|---|

| タイトル: | Perceptually-Aligned Dynamic Facial Projection Mapping by High-Speed Face-Tracking Method and Lens-Shift Co-Axial Setup |

| 著者: | Hao-Lun Peng, Kengo Sato, Soran Nakagawa, and Yoshihiro Watanabe |

| DOI: |

10.1109/TVCG.2025.3527203 |

研究者プロフィール

渡辺 義浩 Yoshihiro WATANABE

東京科学大学 工学院 情報通信系 准教授

研究分野:拡張現実、コンピュータビジョン、デジタルアーカイブ、インタラクション

関連リンク

- 明るい環境と高いコントラストを両立するプロジェクションマッピング|旧・東京工業大学

- 遮蔽されても影ができない全方位のダイナミックプロジェクションマッピング|旧・東京工業大学

- マーカー不要で高度な運動物体への投影が可能な プロジェクションマッピング用高速プロジェクタを開発|旧・東京工業大学

- 仮想と現実の未来|旧・東京工業大学

- 2020年度「DLab Challenge」の研究支援に4件 試行支援にも4件を採択|旧・東京工業大学

- 渡辺義浩 Yoshihiro Watanabe|研究者検索システム Science Tokyo STAR Search

- 渡辺研究室

- 情報通信コース(大学院課程)|教育|工学院 情報通信系

- 情報通信系(学士課程)|教育|工学院 情報通信系

- 工学院|大学組織一覧|Science Tokyoについて

- Watanabe Laboratory|YouTube

- Mixed Reality Makeup 0 min try-on studio|株式会社コーセー